Kathimerini.gr

Το 2012, ο Τζόφρι Χίντον και δύο φοιτητές του στο Πανεπιστήμιο του Τορόντο δημιούργησαν μία τεχνολογία που επρόκειτο να αλλάξει τον τρόπο με τον οποίο ο κόσμος αντιλαμβάνεται τις μηχανές και οι μηχανές τον κόσμο. Eθεσαν τα θεμέλια για την κατασκευή συστημάτων τεχνητής νοημοσύνης (ή απλώς ΑΙ). Ωστόσο, πενήντα χρόνια από την έναρξη της απασχόλησής του στον τεχνολογικό τομέα, ο Χίντον άλλαξε στρατόπεδο. Τη Δευτέρα έγινε και επίσημα μέλος μιας διαρκώς αυξανόμενης ομάδας από επικριτές των συστημάτων ΑΙ, οι οποίοι υποστηρίζουν πως ο φρενήρης ρυθμός με τον οποίο η τεχνητή νοημοσύνη κατακτά την αγορά εγκυμονεί αφάνταστους κινδύνους.

Ο Χίντον λέει πως παράτησε τη δουλειά του στην Google, στην οποία εργαζόταν πάνω από μία δεκαετία, ούτως ώστε να μπορεί να μιλάει ελεύθερα για τους κινδύνους αυτούς. Eνα κομμάτι του εαυτού του μετανιώνει πλέον για το έργο της ζωής του. Θα προτιμούσε να μην έχει δώσει πνοή σε κάτι τόσο επικίνδυνο. «Από την άλλη μεριά, καθησυχάζω τον εαυτό μου με τη συνηθισμένη δικαιολογία: Εάν δεν το έκανα εγώ, απλώς θα το έκανε κάποιος άλλος», λέει ο Χίντον στην εκτενή συνέντευξη που παραχώρησε στο σαλόνι του σπιτιού του στο Τορόντο, σε απόσταση λίγων μέτρων από το σημείο όπου εκείνος και οι φοιτητές του είχαν κάνει την επαναστατική εφεύρεση.

Ριζικές αλλαγές

Οι επικεφαλής της παγκόσμιας βιομηχανίας θεωρούν πως η εισαγωγή των νέων συστημάτων τεχνητής νοημοσύνης μπορεί να είναι εξίσου σημαντική για τις ζωές μας με την εισαγωγή του Ιντερνετ στις αρχές του 1990 και μπορεί να οδηγήσει σε ριζικές αλλαγές σε τομείς όπως η φαρμακευτική έρευνα και η εκπαίδευση.

Ωστόσο, ανθρώπους όπως ο Χίντον τους ταλανίζει ο φόβος πως η βιομηχανία αφήνει ανεξέλεγκτο κάτι πολύ επικίνδυνο. Το ΑΙ δεν είναι επικίνδυνο μόνο επειδή μπορεί να παραγάγει παραπληροφόρηση σε ποσότητα και ποιότητα που θα αλλάξει εντελώς τη σχέση μας με την αλήθεια. Σύντομα, μπορεί να απειλήσει και ανθρώπινα επαγγέλματα. Κάτω όμως κι από αυτά, υπάρχει κάτι μεγαλύτερο: το ΑΙ μπορεί να αποτελέσει κίνδυνο για την ίδια την ανθρωπότητα. «Δυσκολεύομαι να καταλάβω με ποιον ακριβώς τρόπο θα αποτρέψουμε τους κακούς ανθρώπους να χρησιμοποιήσουν την τεχνητή νοημοσύνη για κακόβουλους σκοπούς», σχολίασε ο Χίντον.

«Οχι» στο Πεντάγωνο

Τη δεκαετία του ’80 ο Χίντον ήταν καθηγητής ηλεκτρονικών υπολογιστών στο Πανεπιστήμιο Κάρνεγκι Μέλον του Πίτσμπουργκ. Εφυγε όμως για τον Καναδά επειδή δεν ήθελε να δεχτεί τη χρηματοδότηση από το Πεντάγωνο. Οι ΗΠΑ χρηματοδοτούσαν τότε πολύ πρόθυμα την τεχνητή νοημοσύνη αλλά ο ίδιος ήταν εντελώς αντίθετος στη δημιουργία αυτού που αποκαλούσε «στρατιώτες ρομπότ». «Λίγοι άνθρωποι πίστευαν τότε ότι αυτό το πράγμα μπορεί κάποτε να γίνει πιο έξυπνο από τον άνθρωπο», είπε. «Ακόμη κι εγώ πίστευα ότι ήταν πολύ μακριά. Πίστευα ότι για να γίνει κάτι τέτοιο θα χρειαστούν πάνω από 50 χρόνια. Προφανώς, δεν το πιστεύω πλέον», σχολίασε. Οταν παλιότερα τον ρωτούσαν πώς αντέχει να δουλεύει πάνω σε μία τεχνολογία που είναι εν δυνάμει επιζήμια, εκείνος παρέφραζε τον Ρόμπερτ Οπενχάιμερ, τον «κατασκευαστή» της πρώτης ατομικής βόμβας: «Οταν έχεις μπροστά σου μία γλυκιά τεχνολογική πρόκληση, απλώς το κάνεις». Πλέον, δεν λέει το ίδιο.

Ο Χίντον, που έφυγε από την Google, λέει ότι ένα κομμάτι του εαυτού του μετανιώνει για το έργο της ζωής του. Φωτ. CHLOE ELLINGSON / THE NEW YORK TIMES

Ο Χίντον, που έφυγε από την Google, λέει ότι ένα κομμάτι του εαυτού του μετανιώνει για το έργο της ζωής του. Φωτ. CHLOE ELLINGSON / THE NEW YORK TIMES

Προειδοποιούν 1.000 ηγέτες της τεχνολογίας

Στα τέλη Μαρτίου, περισσότεροι από 1.000 «ισχυροί» άνθρωποι στον τομέα της τεχνολογίας υπέγραψαν μια ανοικτή επιστολή, με την οποία προειδοποιούν για τους κινδύνους που εγκυμονεί η ραγδαία αυξανόμενη χρήση της τεχνητής νοημοσύνης.

Η ομάδα, στην οποία συμμετέχουν επιχειρηματίες όπως ο Ελον Μασκ αλλά και επιστήμονες όπως ο «νονός της τεχνητής νοημοσύνης» Τζόφρι Χίντον, ζήτησε από όλες τις επιχειρήσεις που εργάζονται πάνω στα συστήματα αυτά, να «παγώσουν» τις δραστηριότητές τους για τουλάχιστον έξι μήνες ώστε να μπορέσει η επιστημονική κοινότητα να ερευνήσει σε μεγαλύτερο βάθος τους κινδύνους που μπορεί να φέρουν. «Τα συστήματα τεχνητής νοημοσύνης πρέπει να αρχίσουν να αναπτύσσονται μόνον όταν όλοι μας θα είμαστε βέβαιοι ότι η επίδρασή τους θα είναι θετική και οι κίνδυνοι που απορρέουν από αυτά θα είναι διαχειρίσιμοι», αναφέρει η επιστολή.

Ο Γιόσουα Μπέντζιο, καθηγητής και ερευνητής στον τομέα της τεχνητής νοημοσύνης στο Πανεπιστήμιο του Μόντρεαλ, δήλωσε πως «η ικανότητά μας να προβλέψουμε τι μπορεί να πάει στραβά με ένα σύστημα τεχνητής νοημοσύνης είναι εξαιρετικά περιορισμένη. Πρέπει να είμαστε ιδιαίτερα προσεκτικοί». Ο Μπέντζιο είναι ίσως και ο σημαντικότερος άνθρωπος που υπογράφει την επιστολή. Εργαζόμενος μαζί με τους Τζόφρι Χίντον και Γιαν Λε Κουν, κορυφαίο επιστήμονα της τεχνητής νοημοσύνης στην εταιρεία Meta, ο Μπέντζιο αφιέρωσε τέσσερις δεκαετίες για να αναπτύξει την τεχνολογία των νευρωνικών δικτύων που σήμερα χρησιμοποιούν όλες οι εφαρμογές τεχνητής νοημοσύνης οι οποίες μπορούν να παράγουν γραπτό λόγο. Ενα νευρωνικό δίκτυο είναι ουσιαστικά ένα μαθηματικό σύστημα που μπορεί να αναπτύξει διάφορες ικανότητες αναλύοντας δεδομένα. Ολες οι εφαρμογές παραγωγής κειμένου που βασίζονται στο σύστημα των νευρωνικών δικτύων, «ταΐζονται» με έναν τεράστιο όγκο δεδομένων.

Αναγνωρίζοντας μοτίβα στα δεδομένα αυτά, μπορούν μακροπρόθεσμα να τα αναπαράγουν, δημιουργώντας ένα δικό τους πρωτογενές κείμενο. Παρά το γεγονός πως αυτή η τεχνολογία ακόμη κάνει αρκετά λάθη, ο Μπέντζιο προειδοποιεί πως όσο οι ερευνητές ενδυναμώνουν ακρίτως τα συστήματα αυτά, δημιουργούν και νέους κινδύνους.

Αληθινό ή ψεύτικο

Καθώς τα συστήματα αυτά απαντούν στις ερωτήσεις με απόλυτη αυτοπεποίθηση, γίνεται δύσκολο να αντιληφθεί κανείς εάν η πληροφορία που παρέχουν είναι αληθινή ή ψευδής. Πολλοί ειδικοί ανησυχούν ότι στο μέλλον άνθρωποι θα τα εμπιστεύονται για ιατρικές συμβουλές, ψυχολογική υποστήριξη ή απλώς και για πληροφορίες οι οποίες μπορεί να επηρεάσουν προσωπικές τους επιλογές. «Πλέον έχουμε συστήματα που επικοινωνούν μαζί μας χρησιμοποιώντας φυσική γλώσσα· δεν θα μας είναι καθόλου εύκολο να διακρίνουμε το αληθινό από το ψεύτικο», τόνισε ο Μπέντζιο.

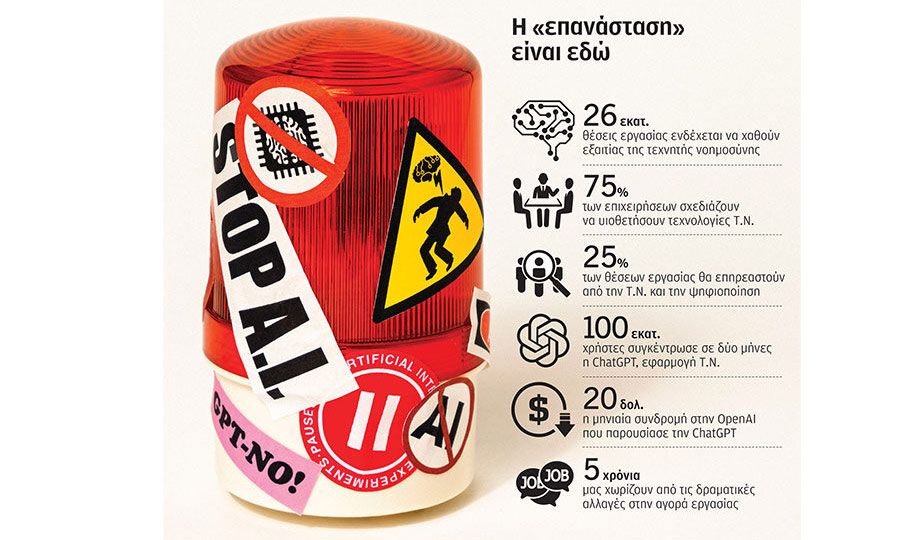

Ηδη οι σχεδιαστές του ChatGPT υποστηρίζουν πως το σύστημά τους μπορεί να αντικαταστήσει κάποιους εργαζομένους, όπως για παράδειγμα ανθρώπους που διορθώνουν κείμενα στο Διαδίκτυο. Μπορεί ακόμη η τεχνολογία να μην είναι αρκετά ισχυρή ώστε να αντικαταστήσει δικηγόρους ή γιατρούς, σύντομα όμως θα μπορεί να αντικαταστήσει προσωπικούς βοηθούς και μεταφραστές. Σύμφωνα με μια μελέτη που συνέταξαν οι ερευνητές της εταιρείας OpenAI, το 80% του εργατικού δυναμικού των ΗΠΑ θα δει τη δουλειά του να επηρεάζεται τουλάχιστον κατά 10% από την τεχνητή νοημοσύνη.

Από τους υπογράφοντες την επιστολή, ορισμένοι δεν κρύβουν ότι φοβούνται και το πιο καταστροφικό σενάριο – η τεχνολογία αυτή να ξεφύγει από τον έλεγχο του ανθρώπου και να καταστρέψει την ανθρωπότητα. Φοβούνται ότι τα συστήματα τεχνητής νοημοσύνης, καθώς επεξεργάζονται όλο και πιο εξειδικευμένα δεδομένα, είναι πιθανό να αποκτήσουν τη δυνατότητα να γράφουν δικό τους κώδικα. Κάτι τέτοιο ακόμη παραμένει σχεδόν απίθανο, όμως στην περίπτωση που συνέβαινε οι συνέπειες θα ήταν πραγματικά αδύνατο να προβλεφθούν.